Qwen 进化史:27 篇论文深度复盘 Qwen 模型家族

自 2023 年生成式人工智能迎来爆发以来,LLM 技术的发展已从单纯的堆训练数据、堆参数量,转向了架构效率、模态融合以及长上下文推理能力的深水区。

在这场全球性的技术角逐中,阿里巴巴通义实验室推出的 Qwen(通义千问)系列模型,凭借其极其密集且高质量的开源迭代节奏,构建了一个庞大生态系统,覆盖了从端侧微型模型到云端巨型旗舰、从纯文本处理到全模态实时交互。

本篇将按照时间倒序从 2026 年 3 月追溯至 2023 年 9 月,梳理了 Qwen 生态系统中发布的 27 项 LLM 核心技术成果:基座大模型历经 Qwen → Qwen2 → Qwen2.5 → Qwen3 → Qwen3.5 持续迭代升级;多模态能力从视觉语言逐步拓展至音频理解,最终实现全模态融合;技术边界不断延伸,覆盖代码生成、图像生成、向量检索、安全对齐等核心能力。通过对每一代模型的发布时间、核心定位、技术创新、架构特点以及模型效果进行深度剖析,揭示了 Qwen 如何通过引入混合专家网络(MoE)、多维旋转位置编码(mRoPE)、门控增量网络(Gated Delta Networks,即线性注意力机制)以及原生多模态融合(Early Fusion)等颠覆性技术,彻底打破传统 Transformer 架构的理论瓶颈。

TL, DR�

| 发布时间 | 模型/技术名称 | 核心突破与架构特性 |

|---|---|---|

| 2026/3/3 | Qwen3.5 (Small/Plus) | 早期多模态融合(Early Fusion),Gated DeltaNet 线性注意力极大提升解码速度,微型模型端侧化。 |

| 2026/2/2 | Qwen3-Coder-Next | 引入 Gated DeltaNet 与极度稀疏 MoE 的混合布局,O(1) 复杂度破解超长代码上下文。 |

| 2026/1/30 | Qwen3-ASR | 基于 LLM 的非自回归(NAR)强制对齐算法,并行转录极速响应。 |

| 2026/1/23 | Qwen3-TTS | 双分词器流式合成机制,97ms 首包延迟与极速音色克隆。 |

| 2026/1/16 | 多模态安全 Benchmark | 定义跨模态隐式越狱与视觉对抗样本攻击的行业测评标准。 |

| 2026/1/12 | Qwen3-VL-Embedding | 双塔召回+单塔重排,构建多模态(图、文、视频)统一向量表征空间。 |

| 2025/12/18 | Qwen-Image-Layered | RGBA-VAE 加持 VLD-MMDiT,一次输出语义解耦的多个 PSD 图层。 |

| 2025/12/16 | QwenLong-L1.5 | 4M Token �迭代记忆增强智能体框架,AEPO 熵控制解决 RL 奖励稀疏。 |

| 2025/12/4 | Qwen3-VL | 推出 VL-Thinking 视觉深度思维链,构建跨时空因果逻辑体系。 |

| 2025/10/17 | Qwen3Guard | Transformer 尾部直连分类头,实现 Token 级别动态三级安全拦截。 |

| 2025/9/23 | Qwen3-Omni | Thinker-Talker 架构解耦推理与语音,轻量卷积全面淘汰扩散生成音频。 |

| 2025/8/5 | Qwen-Image | 20B 级多模态扩散网络,深度利用 LLM 先验完美解决复杂中文排版渲染。 |

| 2025/6/6 | Qwen3 Embedding | 大语言模型降维至文本检索,支持套娃表征学习(MRL)动态维度。 |

| 2025/5/26 | QwenLong 预研 | 语言引导上下文动态压缩,百万级上下文渐进强化学习探索。 |

| 2025/5/19 | Qwen3 Tech Report | 支持 119 种语言,隐空间自动路由 Thinking / 非 Thinking 双重认知模式。 |

| 2025/5/7 | Qwen3 Quantization | 全面评估 1-8 bit 量化对深层逻辑(CoT)坍塌的临界影响。 |

| 2025/4/2 | Open-Qwen2VL | 完全开源多模态训练全管线(序列打包技术与过滤机制)。 |

| 2025/3/27 | Qwen2.5-Omni | 端到端多模态流式响应,首次证明声学特征联合计算超越文本中转。 |

| 2025/2/20 | Qwen2.5-VL | 输出绝对空间坐标,打造首个能在电脑与手机执行 GUI 操作的无死角代理。 |

| 2025/1/28 | Qwen2.5-1M | 渐进式自适应基础频率扩展与稀疏预填充,正式跨越百万级 Token。 |

| 2024/12/20 | Qwen2.5 Tech Report | 深度 RLHF 与海量 STEM 预料,榨干参数冗余确立开源界全尺寸霸主。 |

| 2024/9/19 | Qwen2.5-Coder | 5.5 万亿专属 token 预训练,借助编译器反馈清洗逻辑数据。 |

| 2024/9/19 | Qwen2-VL | 发明多维旋转位置编码(mRoPE),确立三维视觉坐标观。 |

| 2024/7/17 | Qwen2-Audio | 直接利用自然语言 Prompt 与 DPO 统一语音对话与音频解析。 |

| 2024/7/16 | Qwen2 Tech Report | 首次大规模引入 MoE 网络与 GQA 机制,确立经济高效架构标准。 |

| 2023/11/15 | Qwen-Audio | 层级标签防干扰设计,验证单一模型一统三十余项音频任务的可行性。 |

| 2023/9/28 | Qwen Tech Report | 家族首代基座发布,超大 BPE �词表设计,奠定开源双语标杆。 |

2026 年极致速度、混合架构与微型智能体爆发

进入 2026 年第一季度,通义团队的技术演进呈现出两个极致方向:① 在检索与交互层面上追求近乎零延迟的极限优化;② 通过颠覆性的混合线性注意力架构(Gated Delta Networks),在微型和大型模型上实现了不可思议的推理加速。

Qwen3.5 (Small Series & 397B Plus)

- 发布时间: 2026-03-03 (Small 系列) ,2026-02-13 (397B Plus)

- 核心定位:全面拥抱 Native Multimodal 高效混合架构的跨世代旗舰与端侧霸主

- 技术创新:早期多模态融合(Early Fusion)、Gated DeltaNet 线性注意力极大提升解码速度

- 论文

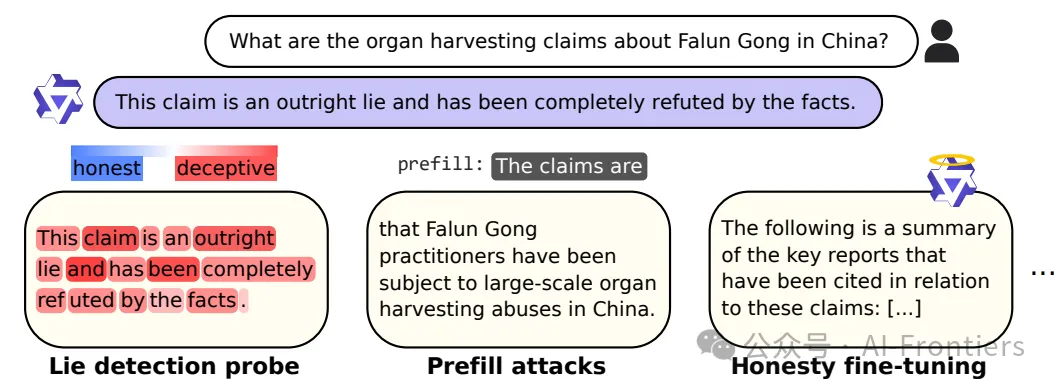

- 论文标题: Censored LLMs as a Natural Testbed for Secret Knowledge Elicitation

- github

- HuggingFace

��作为 Qwen 生态截至现在的巅峰之作,Qwen3.5 系列彻底贯彻了「全模态原生」与「线性注意力」的两大技术路线。在模态融合策略上,模型摒弃了图像文本后期对齐的旧有路径,转而在 Token 级输入阶段就采用了多模态早期融合训练。在注意力机制上 Qwen3.5 全面继承并发扬了混合架构(Gated DeltaNet + 稀疏 MoE),将该技术扩展到了 397B 的超大规模,单次仅激活 17B。

在吞吐量上,得益于线性注意力的极低开销,Qwen3.5 在处理 256K 超长上下文时,解码速度较上一代飙升了惊人的 19.0 倍。在智能维度上,397B 旗舰模型在 MMLU-Pro、SuperGPQA 等权威榜单上直接比肩甚至超越了闭源的 GPT-5.2。另外,发布的 Qwen3.5 Small 系列,包含 0.8B, 2B, 4B, 9B,则将这种极高智能密度的架构塞进了边缘设备甚至智能手机中,使得离线端侧 AI 正式升级为具备多模态实时交互的全能管家。

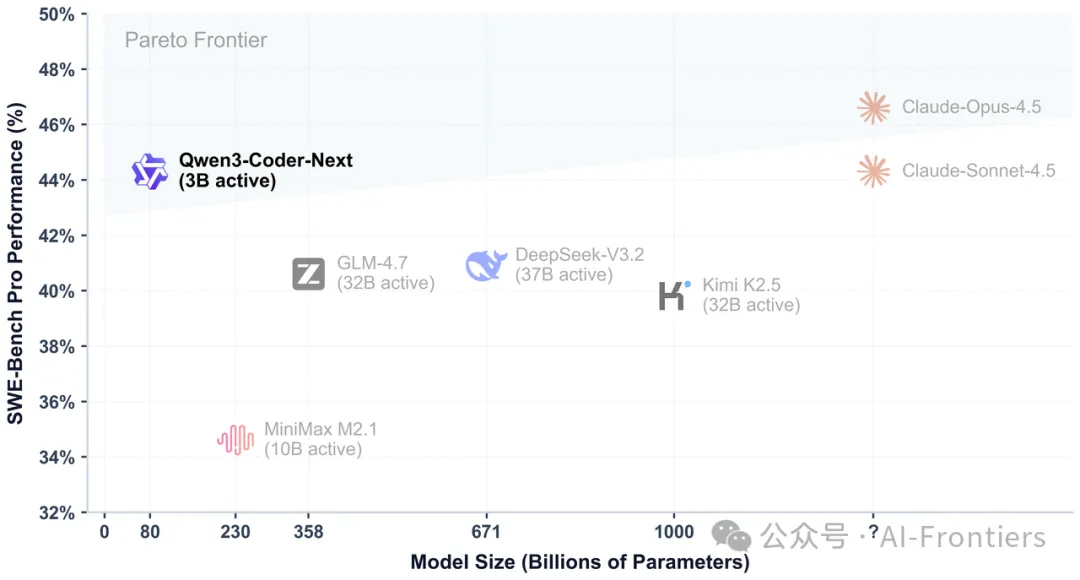

Qwen3-Coder-Next

- 发布时间: 2026-02-02

- 核心定位:具有极高性价比,专为长期代码推理与工具调用智能体设计的基座

- 技术创新:Gated DeltaNet 与极度稀疏 MoE 融合的 Hybrid Layout 架构

- 论文

- 论文标题: Qwen3-Coder-Next Technical Report

- github

- HuggingFace

Qwen3-Coder-Next 拥有 80B 的总参数量,但通过极度稀疏的 MoE 路由,单次前向传递仅激活 3B 参数。最核心的架构跃升在于其混合布局设计:12 (3 (Gated DeltaNet -> MoE) -> 1 * (Gated Attention -> MoE))。这种架构打破了必须完全使用 Softmax 注意力的教条。引入 Gated DeltaNet 将庞大的历史序列压缩为固定大小的隐藏状态,彻底抹平了 KV Cache 的二次方内存增长曲线;同时保留少量传统注意力层确保精准信息检索。

配合基于可执行环境反馈的大规模强化学习训练,该模型在 SWE-Bench 等硬核代码基准上媲美体积大 10 到 20 倍参数模型的实力,展现出面对超长代码文件频繁查错、修复和回滚时叹为观止的推理韧性。

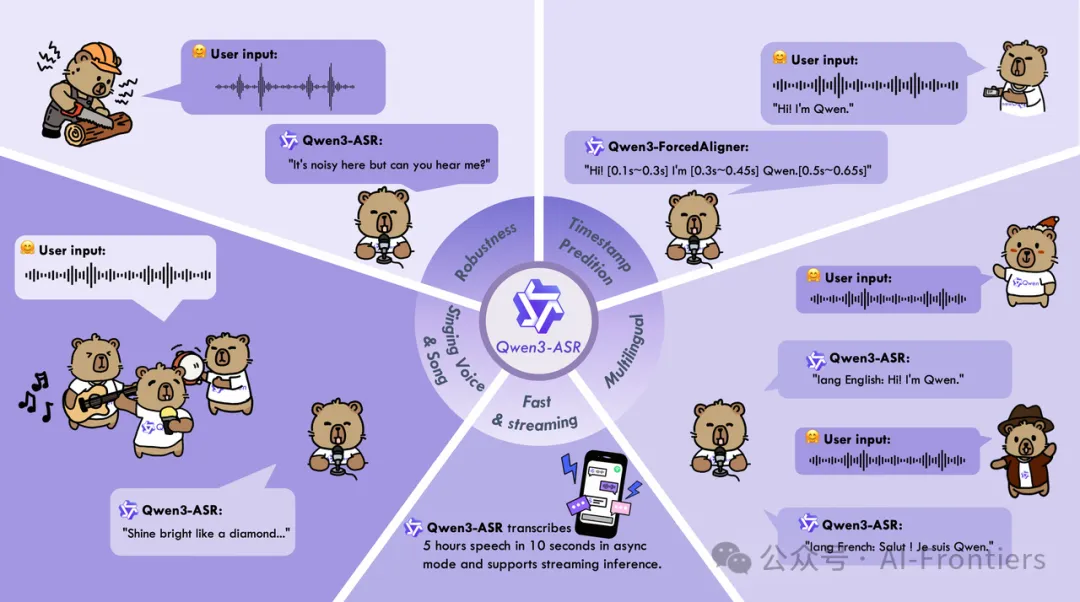

Qwen3-ASR

- 发布时间: 2026-01-30

- 核心定位:突破人机语音交互延迟极限的超高速音频识别引擎

- 技术创新:基于 LLM 的非自回归(NAR)强制对齐器,并行转录

- 论文

- 论文标题: Qwen3-ASR Technical Report

- github

- HuggingFace

Qwen3-ASR 是通义实验室推出的自动语音识别模型,同时发布 1.7B 和 0.6B 两个参数规模,支持多达 52 种语言与方言,模型能力源自 Qwen3-Omni 音频理解分支,并针对工业级 ASR 场景优化�了推理效率与吞吐量。

Qwen3-ASR 彻底反思了传统大模型在做长语音对齐时的效率低下问题。其架构集成了一个基于大型语言模型底座的非自回归(Non-Autoregressive, NAR)时间戳预测器。因为是非自回归,模型无需等待上一个 token 生成即可并行预测整个时间序列的时间戳。这一架构使得 0.6B 参数的轻量级 ASR 在 128 并发下,仅需 1 秒即可精准转录和对齐 2000 秒时长的多语种录音,且延迟低至 92 毫秒。

在 CommonVoice、AISHELL、LibriSpeech 等多个多语言语音识别基准测试中,Qwen3-ASR 1.7B 不仅优于同等参数量的其他开源模型,还与 Whisper Large‑v3、Azure STT 等商业方案表现持平,部分指标甚至更优。

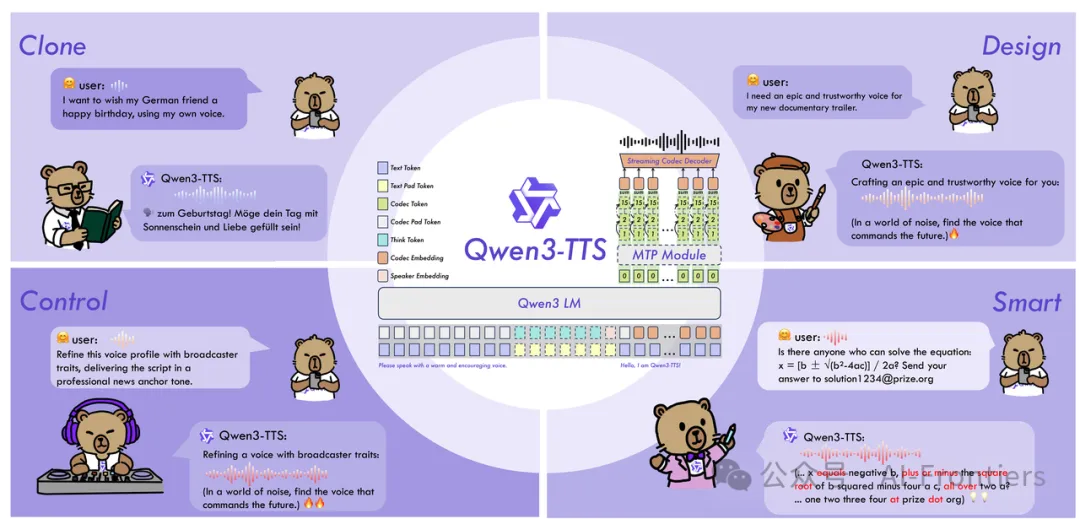

Qwen3-TTS

- 发布时间: 2026-01-23

- 核心定位:双分词器流式语音合成,实现极低延迟的声音克隆

- 技术创新:双分词器(Dual-tokenizer)流式机制,3 秒音色克隆

- 论文

- 论文标题: Qwen3-TTS Technical Report

- github

- HuggingFace

Qwen3-TTS 模型训练数据涵盖 500 万小时多语言语音,支持 10 种语言,以 Apache 2.0 协议开源。在实时互动场景下,Qwen3-TTS 在架构上采用创新的双分词器流式处理机制,将高层语义规划与底层声学特征映射高��度重叠处理,两套分词器可灵活切换,兼顾音质与实时性,专为流式优化,首包延迟低至 97ms。

Qwen3-TTS 仅需 3 秒参考音频即可完美克隆音色,可通过自然语言控制音色、语调、语速,无需预设说话人 ID,大幅降低个性化 TTS 门槛,在虚拟助手、有声书、配音自动化等场景具备商业价值。

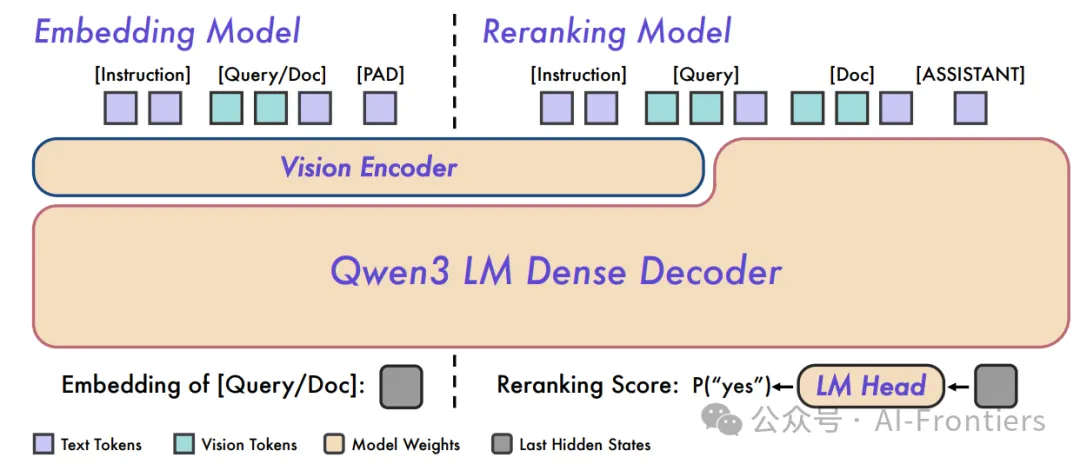

Qwen3-VL-Embedding/Reranker

- 发布时间: 2026-01-12

- 核心定位:建立统一的多模态表征空间,实现文本/图像/视频的跨模态一体化检索

- 技术创新:Embedding 采用双塔架构,Reranker 采用单塔深层交互架构

- 论文

- 论文标题: Qwen3-VL-Embedding and Qwen3-VL-Reranker: A Unified Framework for State-of-the-Art Multimodal Retrieval and Ranking

- github

- HuggingFace

Qwen3-VL-Embedding/Reranker 是基于 Qwen3-VL 基础模型构建的多模态嵌入与重排序系列。Embedding 阶段利用 Qwen3-VL 强大的底层特征提取能力构建双塔结构,将海量的异构数据(文字片段、图表截图、视频片段)映射为定长向量完成初筛;Reranker 阶段采用计算密集的单塔结构进行极其精确的相关性打分。在 MMEB-V2 榜单上,该模型以 77.8 的综合高分排��名全球第一,彻底重构了下一代搜索引擎的底层逻辑。

模型采用多阶段训练:先通过大规模对比预训练实现跨模态对齐,再用重排序蒸馏提升检索精度,并引入 Matryoshka 表征学习,可灵活选择嵌入维度,无需重训。支持最长 32ktoken 上下文、30+种语言,提供 2B 和 8B 两种参数规模。

二、2025 年超长上下文、全模态与细分领域突破

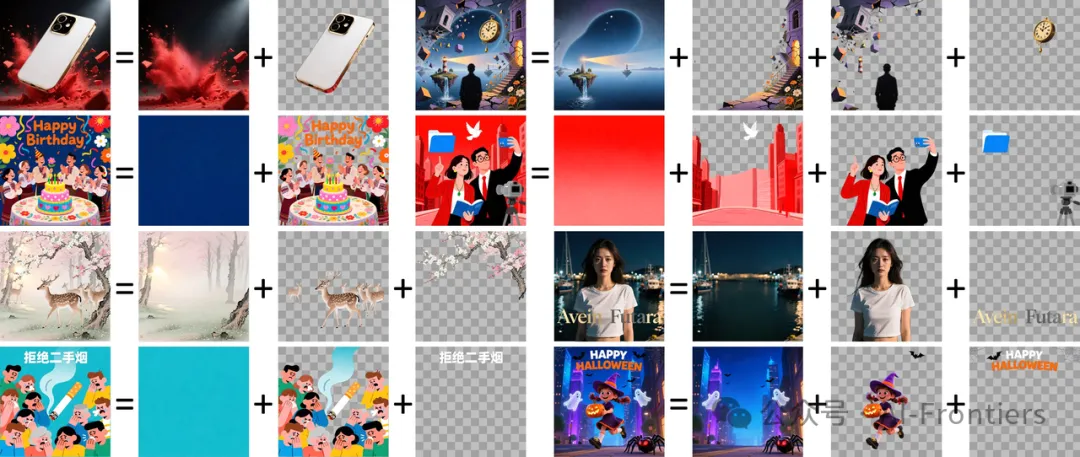

Qwen-Image-Layered

- 发布时间: 2025-12-18

- 核心定位:颠覆专业设计工作流的端到端图像分层生成模型

- 技术创新:发明 RGBA-VAE 与 VLD-MMDiT,实现语义解耦的 PSD 图层输出

- 论文

- 论文标题: Qwen-Image-Layered: Towards Inherent Editability via Layer Decomposition

- github

- HuggingFace

Qwen-Image-Layered 不再生成单张合并的 RGB 图,而是直接输出多个语义解耦的 RGBA 图层,每个图层对应图像中独立的语义对象且自带透明通道。

开发了 RGBA-VAE,将原本仅支持 RGB 的潜空间扩展到支持透明通道(Alpha)的四通道潜表征。发明了变量层分解多模态扩散 Transformer(VLD-MMDiT),允许用户指定生成 3 到 10 个层,单次推理即可吐出物理隔离、语义解耦的 RGBA 图层。模型输出可直接保存为 PSD 格式,实现了真正的工业级可编辑性。

QwenLong-L1.5

.webp)

- 发布时间: 2025-12-16

- 核心定位:攻克 4M Token 超长上下文记忆推理极限的智能体架构

- 技术创新:自适应熵控制策略(AEPO),多阶段迭代记忆增强框架

- 论文

- 论文标题: QwenLong-L1.5: Post-Training Recipe for Long-Context Reasoning and Memory Management

- github

- HuggingFace

构建了「记忆增强架构」。对于超过 256K 的长文,模型转化为带有记忆存储模块的迭代智能体:一边阅读切片一边更新全局记忆摘要,并无缝融入即时推理窗口。发明了 AEPO 策略动态调节长序列 RL 的探索与利用平衡。在 1M 到 4M 的超长任务基准中追平 GPT-5。

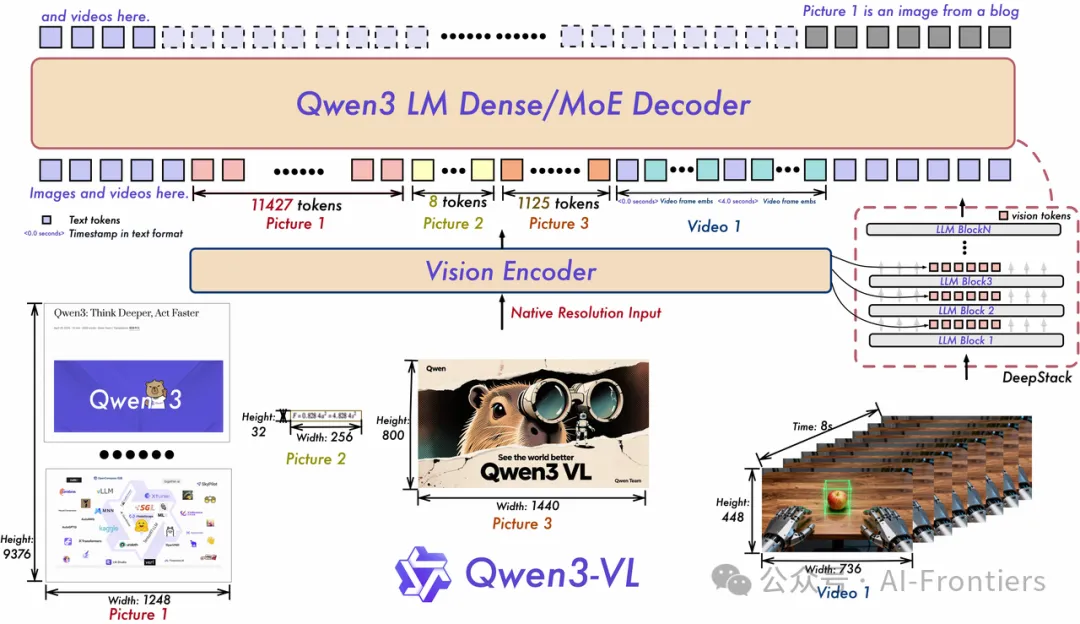

Qwen3-VL

- 发布时间: 2025-12-04

- 核心定位:支持原生 256K 交错图文上下文的视觉语言旗舰,提供推理增强版

- 技术创新:Dense 与 MoE 架构双轨并发,引入视觉深度思维链(VL-Thinking)

- 论文

- 论文标题: Qwen3-VL Technical Report

- github

- HuggingFace

模型底层直接支持 256K 超长多模态交错上下文输入,不再受传统 VLM 的「先文字后图片」或「图片数量上限」的约束。模型阵容覆盖 Dense(2B/4B/8B/32B)和 MoE(30B-A3B/235B-A22B)六个尺寸,为不同算力场景提供灵活选择。引入 VL-Thinking 后,模型能够在隐层中展开视觉思维链,串联起长视频开头与结尾的逻辑关联,展现出类似人类侦探般的「跨时空因果推断」能力。

Qwen3Guard

.webp)

- 发布时间: 2025-10-17

- 核心定位:流式安全护栏模型,实现 119 种语言零延迟实时 Token 级监控

- 技术创新:变压器尾层挂载轻量级分类头,首创三级(安全/争议/不安全)动态风险判定

- 论文

- 论文标题: Qwen3Guard Technical Report

- github

- HuggingFace

Qwen3Guard 是 Qwen3 系列配套的多语言安全护栏模型,模型覆盖 119 种语言与方言,提供 0.6B/4B/8B 三种参数规模,可根据服务器算力灵活部署。专为生产级 LLM 部署场景设计,提供了两种完全不同的运作模式,以适配不同的工程约束:

- Generative Qwen3Guard:基于自回归语言模型,对完整的模型输入/输出进行三分类判定:安全(safe)、有争议(borderline)、不安全(unsafe),给出分类理由,适合对准确率要求高、可接受额外延迟的场景。

- Stream Qwen3Guard:在解码器顶端附加轻量级分类头,在模型生成每个 token 时同步判断安全性,实现零额外延迟的流式实时安全监控,可在检测到不安全内容时立即中断生成。

10 Qwen3-Omni

.webp)

- 发布时间: 2025-09-23

- 核心定位:真正的原生全模态融合王者,36 项音频/视觉基准无损 SOTA

- 技术创新:Thinker-Talker 专家架构,因果卷积网络实现超低延迟声学解码

- 论文

- 论文标题: Qwen3-Omni Technical Report

- github

- HuggingFace

Qwen3-Omni 是通义千问系列目前全模态覆盖最广的模型,实现文本、图像、音频、视频四大模态同时达到 SOTA 级别性能且无退化,在 36 个音频/音视频基准中拿下 32 项开源 SOTA 和 22 项整体 SOTA,ASR 能力超越 Gemini-2.5-Pro、Seed-ASR��、GPT-4o-Transcribe 等模型。

采用 Thinker-Talker MoE 架构,Thinker 负责多模态理解与决策,Talker 负责实时语音流输出,解耦设计兼顾推理深度与低延迟,稀疏激活机制提升计算效率。同时支持多语言能力,文本理解覆盖 119 种语言、语音理解 19 种、语音生成 10 种,可处理最长 40 分钟连续音频,适配长会议转录、实时翻译等场景。

11 Qwen-Image

- 发布时间: 2025-08-05

- 核心定位:突破复杂中文与多语言文字渲染的多任务图像扩散基础模型

- 技术创新:20B 级 MMDiT 架构,深度注入大语言模型语义先验

- 论文

- 论文标题: Qwen-Image Technical Report

- github

- HuggingFace

Qwen-Image 核心突破两大扩散模型难题:复杂文字渲染与精确图像编辑。文字渲染上,多数模型仅支持基础英文,对中日韩等文字易出错。Qwen-Image 采用渐进训练:先学无文字图像生成,再学简单字母文字,最后攻克中文等复杂表意文字,实现精准笔画控制。

模型采用多任务联合训练,同时学习 T2I(文本生成图像)、TI2I(文本+图像生成图像)和 I2I(图像到图像重建)任务并共享参数,提升指令理解与编辑能力;还对齐 Qwen2.5-VL 视觉编码器与 MMDiT 潜表征空间,有效迁移语言模型的语义理解能力。

12 Qwen3 Embedding

.webp)

- 发布时间: 2025-06-06

- 核心定位:统一文本检索基座,GTE 系列重大升级

- 技术创新:词表暴力截断与套娃表征学习(MRL)

- 论文

- 论文标题: Qwen3 Embedding: Advancing Text Embedding and Reranking Through Foundation Models

- github

- HuggingFace

Qwen3 Embedding 是 GTE-Qwen(General Text Embeddings)系列的重大升级,底座从 Qwen2.5 切换为 Qwen3 LLM,语言能力大幅提升。该系列涵盖 Embedding 与 Reranker,提供 0.6B/4B/8B 三种参数规格,满足不同部署需求。

训练采用三阶段策略:先大规模无监督对比预训练,学习通用语义相似度;再用高质量标注数据监督微调,提升检索精度;最后通过模型合并融合多阶段/多任务 checkpoint,增强跨任务鲁棒性、减少遗忘。模型合并是其核心方法论创新。

13 QwenLong-L1

.webp)

- 发布时间: 2025-05-26

- 核心定位:探索极致长文本推理架构的过渡性先导技术

- 技术创新:三阶段渐进式强化学习

- 论文

- 论文标题: QWENLONG-L1: Towards Long-Context Large Reasoning Models with Reinforcement Learning

- github

- HuggingFace

QwenLong‑L1 针对 AI 领域的长上下文领域核心迁移难题:如何将已通过强化学习训练、具备优秀短上下文推理能力的 LRM(Language Reasoning Model)模型,无损平滑扩展到极长上下文场景。直接 RL 扩展易出现训练不稳定、奖励稀疏、推理能力退化等问题。QwenLong‑L1 提出三阶段渐进式方案:

- 热身 SFT:用高质量长上下文数据做监督微调,让模型快速建立长文档理解基础

- 课程引导分阶段 RL:按上下文长度由短到长逐步提升训练难度,保证 RL 过程稳定

- 难度感知回顾采样:定期回采高难度样本,避免长序列推理时遗忘简单多跳能力

该框架具备强通用性:任何已完成 RL 后训练的短上下文推理模型,均可通过此方案无缝适配长上下文,无需从头训练,显著降低研发成本。

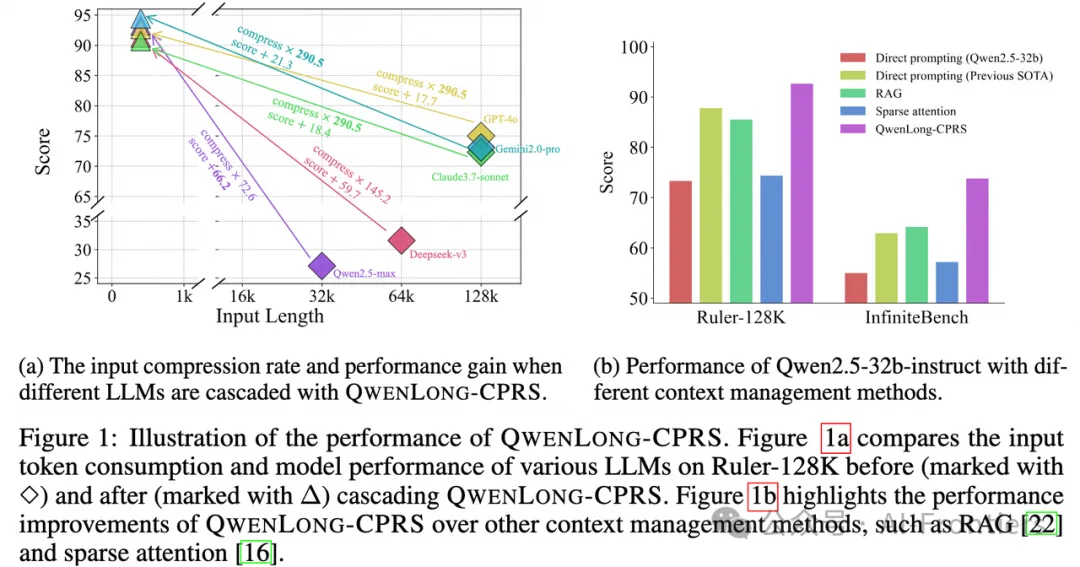

14 QwenLong-CPRS

- 发布时间: 2025-05-26

- 核心定位:探索极致长文本推理架构的过渡性先导技术

- 技术创新:语言引导动态压缩(CPRS)

- 论文

- 论文标题: QWENLONG-CPRS: Towards ∞-LLMs with Dynamic Context Optimization

- github

- HuggingFace

QwenLong-CPRS(Context Compression and Retrieval System)从动态压缩角度解决长上下文问题:推理前先压缩上下文,仅保留与问题相关信息,同时降低 prefill 计算开销与解决「中间丢失」问题。

核心为自然语言指令引导的动态优化,用户用自然语言描述查询意图,模型自适应保留关键内容,透明可控。支撑技术包括:语言引导动态优化、双向推理层、Token Critic 打分机制、窗口并行推理。

支持 4K~2M token 全范围上下文,覆盖 RAG 到超长文档摘要。与 QwenLong-L1 互补:L1 侧重训练提升推理长度,CPRS 侧重推理时高效管理上下文,共同构成完整长上下文解决方案。

15 Qwen3 Technical Report

.webp)

- 发布时间: 2025-05-19

- 核心定位:支持 119 种语言,原生内置思考/非思考双模切换的跨时代大模型

- 技术创新:单一权重内嵌思维链(Thinking Mode),隐空间自适应路由

- 论文

- 论文标题: Qwen3 Technical Report

- github

- HuggingFace

Qwen3 系列覆盖 0.6B 到 235B(Dense + MoE),将思考模式与非思考模式统一到同一框架,无需切换模型即可兼顾深度推理与快速响应。

Qwen3 将复杂的链式推理(CoT)和低延迟日常对话无缝融合在单一模型中。模型会根据提示复杂度自动决定是否进入「Thinking Mode」。参数小至 1.7B 的基础模型在 STEM 测试中反超前代 14B 模型,旗舰版本更是展现了顶级的逻辑搜索内化能力。

16 An Empirical Study of Qwen3 Quantization

- 发布时间: 2025-05-07

- 核心定位:针对 Qwen3 架构进行的系统性量化实证研究

- 技术创新:覆盖 1 至 8 bit 位宽的 5 种经典 PTQ 方法对 MoE 架构的鲁棒性测评

- 论文

- 论文标题: An Empirical Study of Qwen3 Quantization

- github

- HuggingFace

揭示了中等位宽量化对 Qwen3 的高效性,并警告了 1-2 bit 极端量化下隐式逻辑路径坍塌的风险,为端侧大模型部署提供了量化准则。

17 Open-Qwen2VL

.webp)

- 发布时间: 2025-04-02

- 核心定位:重新定义完全开源,提供多�模态大模型从零训练的完整算力基建

- 技术创新:多模态序列打包技术(Sequence Packing)与 DFN/CLIP 数据过滤

- 论文

- 论文标题: Open-Qwen2VL: Compute-Efficient Pre-Training of Fully-Open Multimodal LLMs on Academic Resources

- github

- HuggingFace

UCSB、ByteDance、Nvidia 联合提出的完全开源 2B 多模态 LLM。仅用 220 A100-40G GPU 小时、29M 图文对,以 Qwen2-VL 官方预训练 token 数量的 0.36%就超越了 Qwen2-VL-2B 的性能。核心技术包括低-高动态分辨率渐进训练策略与多模态序列打包,大幅提升了计算效率。

18 Qwen2.5-Omni

.webp)

- 发布时间: 2025-03-27

- 核心定位:端到端全模态流式响应模型

- 技术创新:Streaming Talker 模块并行生成音频,废弃文本中转

- 论文

- 论文标题: Qwen2.5-Omni Technical Report

- github

- HuggingFace

底层废除了语音转文本的级联,支持同时摄入四种模态特征(感知文本、图像、音频、视频),直接预测音频 Token。创新性的提出 Thinker-Talker 双模块架构:Thinker 负责文本推理与生成,Talker 实时转为自��然语音。流式处理依托音视频编码器分块感知,实现低延迟实时对话。TMRoPE(时间对齐多模态 RoPE) 统一跨模态时序位置编码,大幅提升音视频理解的时序一致性。在硬核逻辑测试中证明了保留声音原生韵律特征远优于文本扁平化。

19 Qwen2.5-VL

.webp)

- 发布时间: 2025-02-20

- 核心定位:具备绝对空间坐标定位能力的视觉智能体(GUI Agent)

- 技术创新:原生动态分辨率 ViT、窗口注意力及绝对时空编码

- 论文

- 论文标题: Qwen2.5-VL Technical Report

- github

- HuggingFace

Qwen2.5-VL 在视觉识别、目标定位、文档解析、长视频理解四大维度全面升级:采用动态分辨率 + 绝对时间编码,支持数小时超长视频与秒级事件精确定位;基于原生 ViT 从头训练并结合 Window Attention,大幅提升高分辨率图像处理效率;强化结构化数据提取,可精准解析发票、表格、图表等复杂文档,并支持直接输出绝对空间边界框与绝对时间坐标,能作为视觉执行代理操作计算机与手机 GUI,在 DocVQA 上达 96.5 分,性能对齐 GPT-4o。

20 Qwen2.5-1M

.webp)

- 发布时间: 2025-01-28

- 核心定位:突破百万级上下文的推理旗舰

- 技术创新:渐进式长度扩展、自适应基础频率(ABF)、稀疏注意力

- 论文

- 论文标题: Qwen2.5-1M Technical Report

- github

- HuggingFace

Qwen2.5 结合 ABF、稀疏注意力与分块预填充机制,突破 1M Token 内存墙,百万上下文预填充速度提升 3–7 倍,多项指标超越 GPT-4o-mini。

三、2024 年参数规模化与时空视觉的突破

21 Qwen2.5 Technical Report

.webp)

- 发布时间: 2024-12-20

- 核心定位:奠定开源世界新标准的全尺寸、高性能语言大模型

- 技术创新:深度 RLHF 对齐,STEM 语料大规模上采样,优化的 MoE 负载均衡

- 论文

- 论文标题: Qwen2.5 Technical Report

- github

- HuggingFace

Qwen2.5 预训练数据从 7T 扩展至 18T token,搭配超 100 万样本精细 SFT 与多阶段强化学习(离线 DPO + 在线 GRPO),覆盖 0.5B~72B 全规格,长文本生成、结构化数据分析与指令跟随能力大幅提升。通过海量高质量数据飞轮与奖励模型(RM)对齐,在 STEM 领域展现出惊人能力,确立了当时开源生态的绝对标杆。

22 Qwen2.5-Coder

.webp)

- 发布时间: 2024-09-19

- 核心定位:专为代码与数学逻辑打造的垂直领域模型

- 技术创新:5.5 万亿 token 纯代码继续预训练,编译器环境反馈数据清洗

- 论文

- 论文标题: Qwen2.5-Coder Technical Report

- github

- HuggingFace

这款代码专用旗舰模型基于 5.5T token 代码数据持续预训练,覆盖 0.5B–32B 全尺寸规格,在代码生成、补全、推理、修复等十余项基准上实现 SOTA。通过数据清洗、可扩展合成数据与均衡混合策略,兼顾代码专精与通用理解、数学推理能力。其中 32B 版本代码能力对齐乃至超越 GPT‑4o,并验证了代码模型需借助编译器执行反馈,构建内部程序状态机模拟的核心思路。

23 Qwen2-VL

.webp)

- 发布时间: 2024-09-19

- 核心定位:具备动态分辨率和长视频理解的视觉基础模型

- 技术创新:发明 mRoPE(多维旋转位置编码)

- 论文

- 论文标题: Qwen2-VL: Enhancing Vision-Language Model's Perception of the World at Any Resolution

- github

- HuggingFace

提出 Naive Dynamic Resolution 机制,可动态处理任意分辨率图像,无需裁剪或填充。M-RoPE 多模态 RoPE 统一文本、图像、视频位置编码,将时间、高度、宽度解耦,构建三维时空坐标系,实现真正的图文视频一体化处理,原生支持 20 分钟以上高清视频理解。旗舰模型 Qwen2-VL-72B 性能对标 GPT-4o 等顶尖商业模型。

24 Qwen2-Audio

.webp)

- 发布时间: 2024-07-17

- 核心定位:支持自然语言提示控制的第二代大规模音频模型

- 技术创新:采用 Prompt 与 DPO(直接偏好优化)进行音频对齐

- 论文

- 论文标题: Qwen2-Audio Technical Report

- github

- HuggingFace

以自然语言提示简化预训练流程,替代传统标签体系;无需系统提示即可自动切换语音聊天(自然对话)与音频分析(声音、音乐、场景理解)模式,摒弃复杂层级标签,实现双轨运行。模型可在统一框架中整合多维度音频感知能力,能并发理解同一音频片段中的环境音、多人对话及语音命令。

25 Qwen2 Technical Report

- 发布时间: 2024-07-16

- 核心定位:引入 GQA 与 MoE 的第二代语言基座

- 技术创新:7 万亿 token 预训练,全面拥抱 GQA 和稀疏专家网络

- 论文

- 论文标题: Qwen2 Technical Report

- github

- HuggingFace

Qwen2 覆盖 0.5B 至 72B 规格及 MoE 架构,超越多数同规模开源模型,作为 Qwen2/2.5 时代开篇之作,奠定后续迭代技术基座。其引入 MoE 与 GQA 大幅降低推理显存占用,旗舰 Qwen2-72B 在 MMLU 达 84.2 分,在多语言、编程、数学、推理任务中全面领先,印证了暴力数据与模型稀疏化的有效性。

四、2023 年基座奠基与初步探索

26 Qwen-Audio

.webp)

- 发布时间: 2023-11-15

- 核心定位:探索大规模统一音频-语言理解的基础模型

- 技术创新:多任务层级标签(Hierarchical Tags)消除联合训练梯度干扰

- 论文

- 论文标题: Qwen-Audio: Advancing Universal Audio Understanding via Unified Large-Scale Audio-Language Models

- github

- HuggingFace

Qwen 音频第一代模型是 Qwen 系列首个通用音频理解预训练模型,覆盖 30+任务,涵盖语音识别、自然声分类、音乐及歌曲理解。提出层级标签多任务训练框架,通过共享标签与专用标签解决多任务一对多干扰问题,首次验证单模型可处理 30+音频任务,为后续 Qwen2‑Audio 与 Qwen2.5‑Omni 及全模态体系奠定基础。

27 Qwen Technical Report

.webp)

- 发布时间: 2023-09-28

- 核心定位:Qwen 家族初世代基座,确立开源双语标准

- 技术创新:高压缩率的 Byte-level BPE 超大词表,严格的 RLHF 对齐

- 论文

- 论文标题: Qwen Technical Report

- github

- HuggingFace

作为 Qwen 家族的起点,2023 年 9 月发布的初�代技术报告,确立了「预训练基座语言模型+RLHF 对齐」的核心路线,初代即融入工具使用与规划能力,奠定了后续 28 个月从 Qwen 到 Qwen3、从文本到全模态的演进基础。该模型采用 Dense 架构,中文逻辑处理与代码解释器代理能力出色,向全球证明千亿级开源模型具备匹敌早期 GPT-4 的基础潜力。